D2

Администратор

- Регистрация

- 19 Фев 2025

- Сообщения

- 4,380

- Реакции

- 0

Постоянно читаю новости о новых моделях но не могу запустить иза того что не хватает gpu! Бывает такое ? Щас расскажу где найти сервер для запуска модели

Начну с начала: Чтобы запустить модель нам нужна утелита для запуска модели, в нашем случае ollama,

Оф сайт https://ollama.com/

ollama позволяет легко запускать модель на своем сервере как серверную часть так и клиентскую часть и это мы будем использовать

Начнем с установки ollama заходим на ollama.com и скачиваем

Скачиваем и устанавливаем стандартная установка Next Next Next

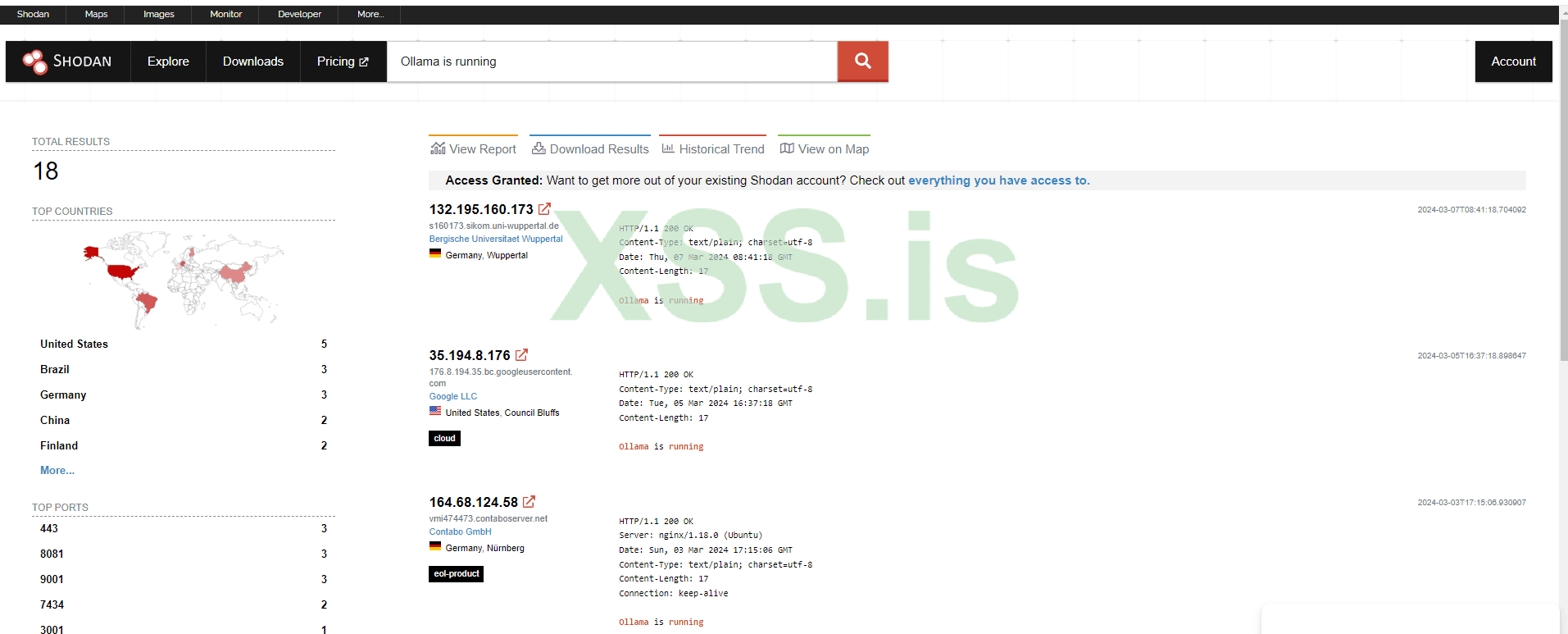

Теперь самое интересное мы можем запустить сервер из своего пк но можем подключиться уже к запущенному серверу, подумав где можно найти такой сервер я вспомнил про shodan (у меня есть ключ на 175к продаться ) заходим в https://www.shodan.io/search и вводим "Ollama is running"

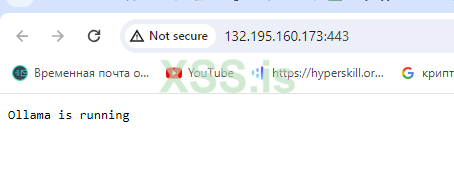

Теперь нам нужно подключиться к нему , переходим по линку

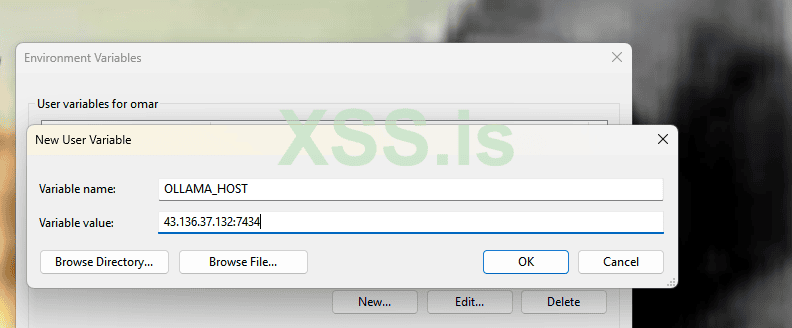

копируем адрес и нам нужно выставить переменную

Спойлер: линукс

виндовс:

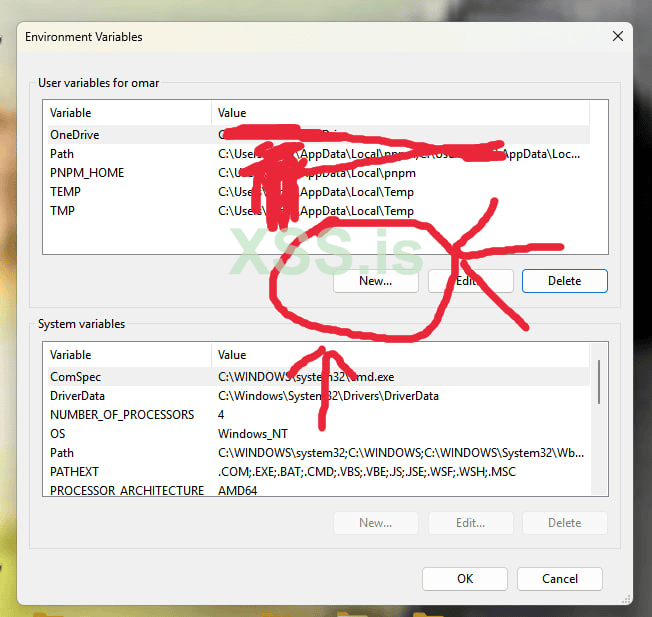

нажимаем WIN пишем varibles открываем едитор

Нажимаем Ок Ок и запускаем Ollama

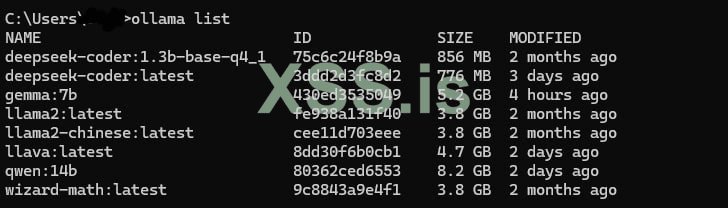

переходим в cmd и вводим ollama list чтобы увидеть установленные модели

дальше если хотите другую модели переходим в

находим модель которую хотим запустить - Скачать

Начну с начала: Чтобы запустить модель нам нужна утелита для запуска модели, в нашем случае ollama,

Оф сайт https://ollama.com/

ollama позволяет легко запускать модель на своем сервере как серверную часть так и клиентскую часть и это мы будем использовать

Начнем с установки ollama заходим на ollama.com и скачиваем

Скачиваем и устанавливаем стандартная установка Next Next Next

Теперь самое интересное мы можем запустить сервер из своего пк но можем подключиться уже к запущенному серверу, подумав где можно найти такой сервер я вспомнил про shodan (у меня есть ключ на 175к продаться ) заходим в https://www.shodan.io/search и вводим "Ollama is running"

Теперь нам нужно подключиться к нему , переходим по линку

копируем адрес и нам нужно выставить переменную

Спойлер: линукс

Setting environment variables on Linux

If Ollama is run as a systemd service, environment variables should be set using systemctl:- Edit the systemd service by calling systemctl edit ollama.service. This will open an editor.

- For each environment variable, add a line Environment under section [Service]:

[Service]

Environment="OLLAMA_HOST=0.0.0.0"

виндовс:

нажимаем WIN пишем varibles открываем едитор

Нажимаем Ок Ок и запускаем Ollama

переходим в cmd и вводим ollama list чтобы увидеть установленные модели

дальше если хотите другую модели переходим в

находим модель которую хотим запустить - Скачать

View hidden content is available for registered users!